Item 1 of 1

撞见女厕所的男人,谁在笑,谁在叫,详解 robots.txt 规则

2471

24712025-05-21 08:10

给你可复用的爆品立项与广告节奏和预算模型

你的独立站 robots.txt 正面临和 【厕所指示牌】同样困境:爬虫大军中混杂着迷路的「误闯者」也有蓄谋已久的「偷窥狂」。

怎么修改网站的 robots.xtx 文档

分2部分 Shopify 与 WordPress(Yoast)的路径指南

1. Shopify 平台的 robots.txt 修改流程

Shopify 为商家提供了编辑 robots.txt 文件的功能,以此对搜索引擎爬虫的抓取范围进行自主调控,具体操作步骤如下:

登录 Shopify 管理后台

使用商家账号登录 Shopify 店铺的管理页面。 进入主题编辑界面

点击页面中的 “在线商店” 选项,随后选择 “主题”。在主题页面中,找到正在使用的 “实时主题” 板块,点击其旁边的 “操作” 按钮,并选择 “编辑代码”。 创建 robots.txt 模板

在代码编辑界面左侧的文件目录中,找到 “模板” 部分,点击 “添加新模板”。此时会弹出一个选项框,将 “创建新模板用于” 的选项更改为 “robots.txt”,最后点击 “创建模板”。Shopify 会自动生成一个名为 “robots.txt.liquid” 的文件,这个文件包含了店铺默认的 robots.txt 规则。 编辑 robots.txt 内容

在生成的 “robots.txt.liquid” 文件中,你可以根据实际需求修改规则。比如,若要阻止特定搜索引擎爬虫访问某个目录,可以添加类似 “Disallow: / 特定目录名 /” 的指令;若要添加网站地图链接,可使用 “Sitemap: https:// 你的域名 /sitemap.xml” 的格式进行添加。完成修改后,点击保存,新的规则便会生效。

2. 借助 Yoast 插件修改 WordPress 的 robots.txt

Yoast SEO 插件是 WordPress 生态中一款强大的 SEO 优化工具,利用它可以便捷地对 robots.txt 文件进行修改:

安装并激活 Yoast SEO 插件

登录 WordPress 网站的后台管理界面,点击 “插件” 菜单,选择 “添加新插件”。在搜索框中输入 “Yoast SEO”,找到该插件后点击 “安装” 按钮,安装完成后再点击 “激活”。 进入文件编辑器

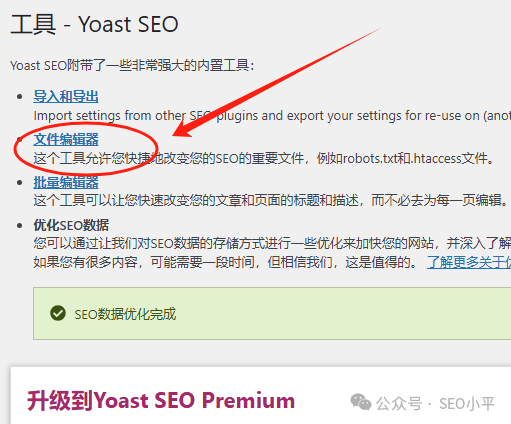

在 WordPress 后台左侧菜单中点击 “Yoast SEO”,在展开的选项中选择 “工具”,然后点击 “文件编辑器”。若 WordPress 禁用了文件编辑功能,该菜单选项可能不会出现,此时需要先在服务器层面或通过主机提供商开启文件编辑权限。

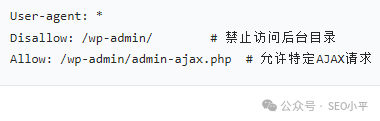

编辑 robots.txt

点击 “创建 robots.txt 文件” 按钮(若已存在该文件,则直接显示文件内容),Yoast SEO 会展示生成的默认 robots.txt 内容。在这里,你可以对文件进行编辑操作,例如添加或删除特定的 “Disallow”“Allow” 指令等。修改完成后,点击保存即可。

一、基础规范:从命名到缓存的底层逻辑

1. 命名与位置:爬虫识别的 “门槛”

命名规则

文件名必须严格为小写的 robots.txt,大小写错误(如Robots.TXT)会导致爬虫直接忽略文件内容,进而引发抓取失控。存储位置

文件需放置在网站根目录(如 https://example.com/robots.txt),子目录存储(如/pages/robots.txt)无效。此外,不同协议(HTTP/HTTPS)、主机名或子域名(如shop.example.com)需单独配置独立的 robots.txt 文件,避免规则冲突。

2. 路径与指令的大小写敏感机制

路径匹配

Disallow和Allow指令中的 URL 路径区分大小写(如/folder/与/Folder/视为不同规则),错误的大小写会导致规则失效。爬虫名称匹配

谷歌对 User-agent值(如Googlebot)不区分大小写,但其他搜索引擎可能敏感,建议统一使用小写规范。

3. 缓存机制:修改生效的 “时间差”

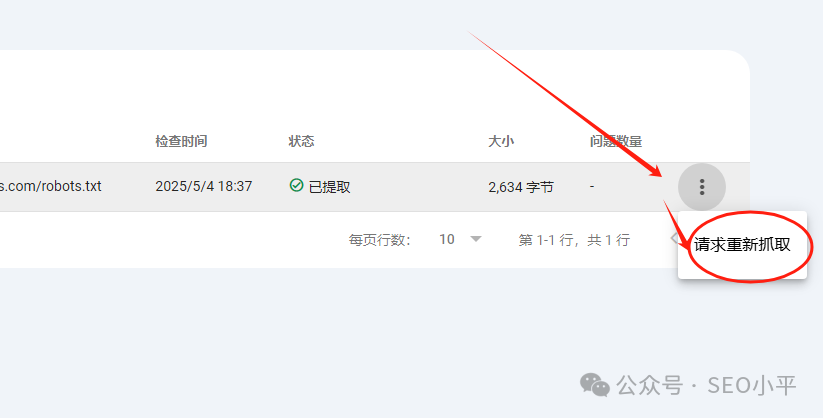

谷歌通常缓存 robots.txt 内容长达 24 小时,若遇服务器错误(如 5xx 状态码),缓存时间可能更长。 可通过 Cache-Control响应头的max-age指令调整缓存周期,或借助 Google Search Console(GSC)请求加速刷新。

二、核心指令:精准控制抓取行为的 “工具箱”

1. User-agent:定位目标爬虫

通配符规则

User-agent: *匹配所有遵守协议的爬虫,规则优先级低于具体爬虫声明(如Googlebot)。各种爬虫细分

针对不同功能的谷歌爬虫(如 Googlebot-Image负责图片抓取),可单独配置规则,实现精细化控制。

2. Disallow 与 Allow:禁止与放行的博弈

禁止抓取

Disallow: /可阻止指定爬虫访问全站;路径支持文件(如/private.html)、目录(如/admin/)或通配符模式(如/*?sessionid=*禁止含会话 ID 的 URL)。精准放行

路径长度优先

当同一 URL 匹配多条规则时,路径前缀最长的规则生效。例如: Allow: /folder/page(长度 12)优于Disallow: /folder/(长度 8)。冲突处理

若路径长度相同(如 Allow: /page与Disallow: /page),谷歌遵循 “限制性最小” 原则,优先执行Allow。

4. 通配符高级应用:* 与 $ 的组合艺术

*匹配任意字符可用于禁止含特定参数的 URL(如 /*?color=阻止含颜色过滤参数的页面)或文件类型(如/*.pdf禁止所有 PDF 文件)。$匹配路径结尾精准区分目录与文件(如 Allow: /search/$仅允许根目录的search页面,排除/search/results.html)。

三、策略对比:robots.txt 与其他 SEO 工具的协同

robots.txt Disallow | robots.txt 文件 | ||||

noindex | <head> 部分 | ||||

X-Robots-Tag: noindex | |||||

rel="canonical" | <head> 部分或HTTP响应头 |

1. 与 noindex 的分工

注意:若页面在 robots.txt 中被Disallow,谷歌将无法读取其noindex标签,导致索引控制失效。

2. 与 Canonical 标签的互补

rel="canonical"用于整合重复内容的权重,需确保非规范页面可被抓取(即不被 robots.txt 阻止),否则标签无效。 策略选择

参数化 URL 若需保留链接信号,优先使用 canonical;若需彻底阻止抓取,再用Disallow。

四、实战场景:从参数处理到资源优化

1. 参数化 URL 管理

会话 ID 与跟踪参数

通过 Disallow: /*?sessionid=或/*?utm_source=阻止无价值参数页面。分面导航

结合通配符(如 /*?*color=)与canonical标签,保留核心过滤组合页面,屏蔽冗余参数组合。

2. 分页内容处理

推荐策略

索引第一页,后续页面使用 noindex, follow,允许抓取以传递链接权重。避免误区

禁止通过 robots.txt阻止分页 URL,否则会阻断深层内容的发现路径。

3. 资源文件抓取策略

核心原则

允许抓取 CSS、JS 等渲染必需资源,避免谷歌无法正确解析页面内容。 例外情况

仅当资源为装饰性或非必要(如第三方跟踪脚本)时,可谨慎阻止。

在更广阔的SEO图景中的定位

robots.txt 禁止抓取某个URL,并不能保证该URL不会被索引如果谷歌通过其他途径(如外部链接、内部链接或站点地图)发现了这个被禁止抓取的URL,它仍然可能将该URL编入索引。正如女厕所有一个侧门,有一些男人从侧门进入了女厕所。这种情况下,由于谷歌未能抓取页面内容,搜索结果中通常不会显示该页面的描述,有时可能会显示URL本身或指向该页面的链接锚文本

TikTok、Facebook、谷歌、Twitter广告服务,0门槛抢占全球流量!

极速开户+优化投流+风险保障+效果跟踪,仅需4步,轻松撬动亿万海外流量,让品牌销量翻倍增长!

已成功开通5000+账户

最新热门报告作者标签

Shein新建英国物流仓库,新增450个岗位SHEIN宣布,在英国米德兰兹地区开设新的电商物流仓库,占地约3.5万平方米,已新增450个工作岗位,使SHEIN在英国支持的物流岗位总数提升至1000个。

TikTok Shop野心藏不住,按下欧洲加速键再上线3国,TikTok Shop决定把“欧洲故事”讲好

亚马逊低价平台Bazaar在印度快速扩张,卖家增至3万名根据亚马逊披露的数据,Amazon Bazaar已有3万名卖家和超过3000万件商品,计划在未来一年将卖家规模扩大1.5至2倍

电商营收大涨44%!Shopee母公司Sea Q1财报出炉Shopee母公司Sea公布了2026年第一季度财报,本季度在Shopee电商、Monee金融科技及Garena游戏业务的共同推动下,整体收入与盈利能力均持续提升。

百亿门前,大卖也难啃利润营收狂奔,一批大卖利润告急

亚马逊品牌推广技巧,如何提高品牌曝光度亚马逊平台的流量竞争日益激烈,品牌推广作为连接消费者与品牌的核心渠道,能够帮助卖家在搜索结果、商品详情页等关键位置触达目标用户,实现短期销量提升与长期品牌资产积累。本文梳理两大广告目标的实操方法与优化技巧,为卖家提供可落地的投放指导。一、明确品牌推广的两大广告目标及配置差异亚马逊品牌推广目前提供两种可选择的广告目标,分别为增加页面访问次数与提升品牌展示量份额。卖家需根据自身业务阶段与核心需求,选择匹配的目标。广告活动创建后目标无法修改,且所有已创建的品牌推广广告活动会默认使用增加页面访问次数目标。

美国上诉法院介入,特朗普10%全球关税继续生效美国联邦上诉法院发布临时决定,暂停下级法院此前裁定特朗普政府10%全球关税违法的判决。这一决定意味着,在案件进一步审理前,相关进口商仍需继续缴纳该项关税。

谷歌接入Klarna和Affirm,AI购物将支持“先买后付”谷歌与“先买后付”(BNPL)服务商Affirm和Klarna达成合作,将在美国市场为谷歌搜索、AI Mode以及Gemini应用中的购物场景提供Affirm和Klarna的分期付款服务。

亚马逊推出动态广告,可根据用户观看记录自动换广告亚马逊Prime Video推出一项名为“Dynamic TV Creative(动态电视创意)”的新工具,可根据观众此前是否看过某个品牌或产品广告,自动调整后续展示的广告内容和形式。

亚马逊德国保健品市场销售额第一,市场份额达43%Kaske Group调查数据显示,2025年,亚马逊在德国非处方药领域的销售额达到25亿欧元,超过欧洲两大上市在线药房企业Redcare Pharmacy(Shop Apotheke)和DocMorris,位居市场第一。

卖家注意!多平台履约考核升级卖家注意!多平台关键考核指标升级

泉州卖家靠一件泳装罩衫,在TikTok美区进账上千万狂卖61700件,国产泳装罩衫成TikTok美区“出单王”

亚马逊正式在美国上线Amazon Now配送服务亚马逊正式在美国推出Amazon Now超快速配送服务,用户下单后最快可在30分钟内收到商品。

亚马逊品牌推广技巧,如何提高品牌曝光度亚马逊平台的流量竞争日益激烈,品牌推广作为连接消费者与品牌的核心渠道,能够帮助卖家在搜索结果、商品详情页等关键位置触达目标用户,实现短期销量提升与长期品牌资产积累。本文梳理两大广告目标的实操方法与优化技巧,为卖家提供可落地的投放指导。一、明确品牌推广的两大广告目标及配置差异亚马逊品牌推广目前提供两种可选择的广告目标,分别为增加页面访问次数与提升品牌展示量份额。卖家需根据自身业务阶段与核心需求,选择匹配的目标。广告活动创建后目标无法修改,且所有已创建的品牌推广广告活动会默认使用增加页面访问次数目标。

2026五大主流跨境收款工具客观实测横评:派安盈、连连、万里汇、空中云汇、PingPong2026年,跨境收款赛道发展更趋成熟,Payoneer派安盈、万里汇、连连国际、空中云汇、PingPong五大主流跨境收款工具,均具备正规合规资质与成熟收款结汇能力,只是各家产品定位、核心功能侧重、适配场景各不相同。不存在绝对最好的收款工具,只有最匹配自身业务模式的选择。本文基于2026年4月各平台官方公开信息、合规牌照公示、真实卖家实测到账体验与长期使用反馈,做客观中立横评。跨境收款工具选型核心原则跨境收款选型不能单一参考提现费率,需综合核算综合使用成本、资金到账时效、合规风控稳定性、配套收付功能、场景适配能力等五大维度。

伊朗互联网中断73天,经济损失超26亿美元伊朗全国性互联网中断已持续73天,在战争、制裁与断网等多个因素的影响下,当地经济正在加速恶化。这是有记录以来持续时间最长的国家级互联网中断之一,已经对企业运营、金融交易、通信系统和工业生产造成广泛冲击。

AMZ123《全球电商市场报告——韩国篇》PDF下载本报告从电商市场环境、消费者画像与营销选品策略等多个维度,聚焦这一市场进行系统性解读,为跨境卖家精准切入韩国市场,把握增量机遇提

供深度参考。

《TikTok Shop 2026年一季度报告》PDF下载2026年第一季度,TikTok Shop在全球(基于所提供的10个站点数据)继续保持强劲的增长态势总GMV已达274.53亿美元,整体市场呈现出核心市场GMV体量巨大、新兴市场爆发式增长的特征美国站以69.85亿美元的GMV稳居榜首,对比25年第一季度增长了66%

《2026游戏出海产业深度解析报告》PDF下载2025年,全球游戏市场彻底走出了调整期,迎来了确定性的复苏增长。根据Newzoo最新发布的全球营收趋势数据显示,2025年全球游戏市场总营收预计将达到1967亿美元,正式逼近2000亿大关。从长期增长曲线来看,行业复合年增长率(CAGR)正从2022-2025年间的4.2%加速攀升,预计在2025-2028年间将达到4.9%,显示出强劲的市场韧性。

《2026数智供应链全球化发展报告》PDF下载数智供应链是基于实时、全域市场数据的开放共创--消费端洞察可直接反馈至研发与设计环节驱动产品快速迭代;供应链生态内数据、工具能力开放共享,降低上下游创新门槛与成本;带来新材料应用、新工艺优化到订阅制、产品即服务(Paas)等新商业模式涌现。

《2025年中国AI应用出海企业发展需求洞察报告》PDF下载AI 应用出海企业指专注于人工智能技术研发及应用,通过将自主开发的 AI产品、服务或解决方案推向海外市场,以实现商业价值和全球布局的企业实体。其核心特征是依托人工智能技术优势,开展跨地域的商业活动,目标市场为海外国家和地区。

《中国软件企业在欧洲市场的数据主权与安全合规指南》PDF下载本白皮书将精准聚焦中国软件企业的出海痛点:从SaaS服务的多租户数据隔离,到DevOps流程中的跨境数据风险,再到软件供应链的安全责任

《日本机会品类调查》PDF下载本报告中的收纳类别范围是指收纳箱/盒、衣柜/衣橱、衣帽架、彩色收纳盒/书架、开放柜/置物架、钢架和洗衣收纳产品,主要用于日本消费者的客厅、卧室、壁柜和浴室。

《12月刊高潜力品类行业洞察报告》PDF下载12月,正值圣诞节及年终购物季,消费者对大家电和相机等大件及礼品类需求显著提升,对美容个护、宠物等刚需品类需求稳健。