你的独立站URL,AI根本看不懂

72

72| 亚马逊官方×实战专家,带你解锁亚马逊高客单产品突围攻略

今天跟大家聊聊独立站的URL是否会影响GEO效果。

某独立站运营者最近发现了一件怪事。

明明店铺有退货政策页面,但 ChatGPT 却一直在告诉用户:"你可以访问 yourbrand.com/returns-policy 查看退货说明。" 用户点进去,404,直接走人。而这个品牌的真实退货页面地址是 yourbrand.com/customer-service/returns。

AI 把 URL 给记错了。然后品牌就这样静悄悄地流失着潜在客户。

这就是 AI 搜索时代出现的新问题——AI 幻觉 URL(URL Hallucination)。AI 引擎知道你的品牌存在,但它"猜"了一个不存在的地址推荐给用户。这不是个例,是系统性现象。

今天讲 3 点:URL 为什么是 GEO(生成式引擎优化)的第一道门、独立站该怎么优化 URL、URL 之外还需要配合做什么。

URL 是 AI 读你网站的第一句话

传统 SEO 的核心是什么?关键词密度、外链数量、页面权重。

GEO(Generative Engine Optimization,生成式引擎优化)的核心是什么?成为 AI 生成答案的直接来源。

这两件事有本质区别。传统搜索引擎是在结果列表里"排名",用户自己选择点哪个。AI 搜索引擎是直接生成答案,把你的内容融进去——或者压根不提你。

AI 在用 RAG(检索增强生成)处理内容时,有一个很多人没意识到的细节:它在阅读你页面第一句话之前,就已经用 URL 作为首要信号来判断"这个页面在讲什么"。URL 结构混乱或语义不清,内容直接出局,连被读到的机会都没有。

而 Google 官方文档对 URL 的要求早就说得很清楚——使用描述性词汇、用连字符(-)分隔单词、避免复杂参数 URL 导致爬虫陷阱。这套规范不只是为了传统 SEO,也是 AI 引擎理解你内容的技术前提。

「信息差正在消失,但认知差永远存在。」 大多数独立站运营者还在用传统 SEO 思维优化 URL,不知道规则已经变了。

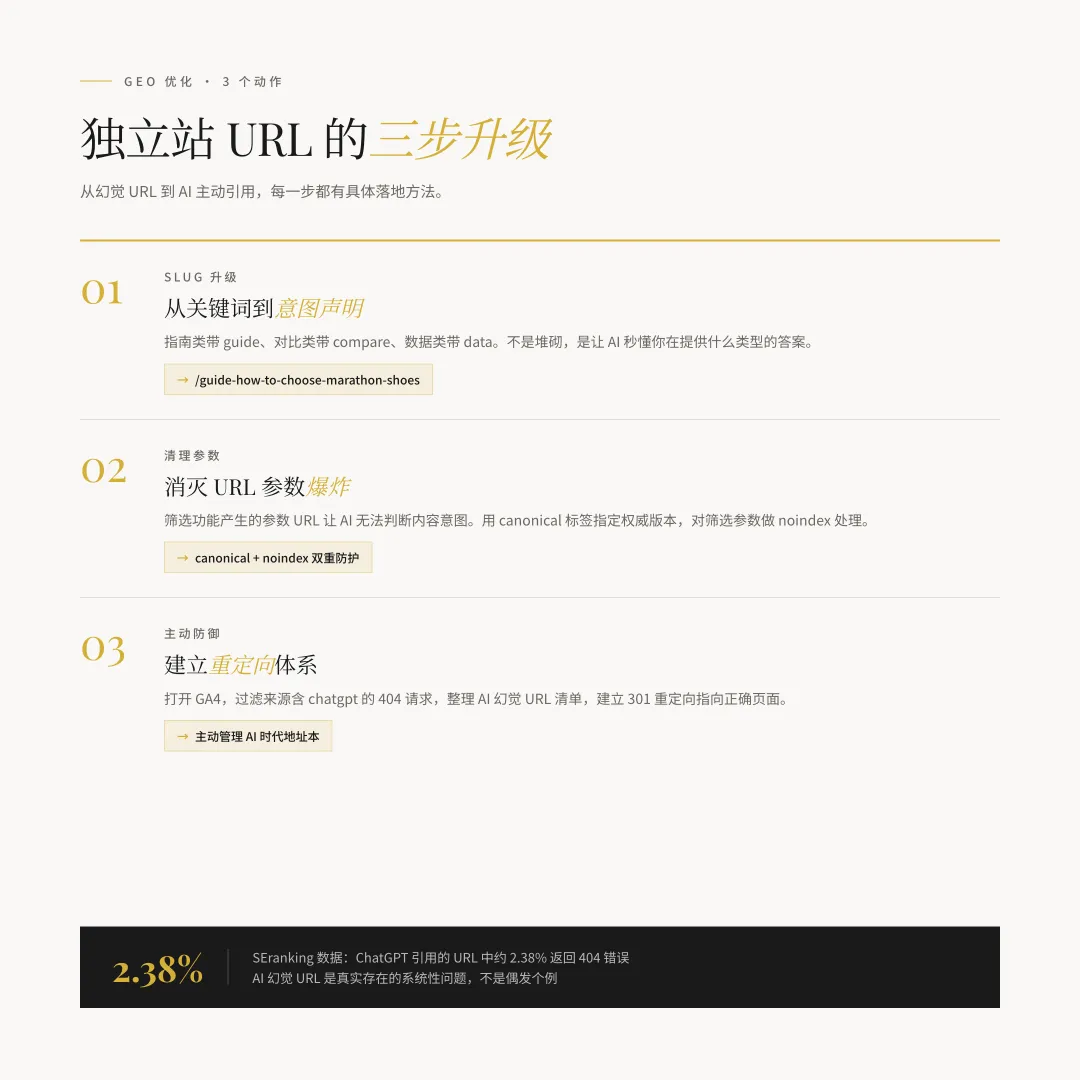

独立站 URL 优化的 3 个具体动作

动作 1:把 slug 从"关键词型"升级到"意图声明型"

旧思路:slug 塞满关键词,比如 /best-running-shoes。

新思路:slug 告诉 AI 这个页面是什么类型的答案,比如 /guide-how-to-choose-marathon-running-shoes。

区别在哪?前者是告诉 AI "这里有跑鞋",后者是在告诉 AI "这里提供的是一份选购指南,答案类型是 How-to"。AI 在生成回答时会优先引用"答案类型明确"的内容。

如果你的页面是对比类,slug 里可以带 compare 或 vs。如果是数据类,带 statistics 或 data。如果是指南类,带 guide 或 how-to。不是生硬堆砌,是用词汇让 AI 秒懂你在提供什么。

这是 NetRanks 提出的语义地址框架(Semantic Address Framework)的核心逻辑——从关键词 URL 到意图 URL 的范式转变。这套理论目前主要是由 NetRanks 自身提出,尚无大规模第三方实证,但背后的逻辑是扎实的:AI 本质上是在做意图匹配,你的 URL 就是最先被读到的意图声明。

动作 2:消灭参数 URL,清理爬虫陷阱

很多独立站(尤其是电商类)都踩过这个坑:筛选功能开放之后,URL 参数爆炸。用户筛了"特价+海景+健身中心",URL 变成 /hotel-search-results.jsp?Ne=292&N=461+4294967240+4294967270。

这类 URL 有几个问题:

第 1,Google 把每个参数组合都视为独立页面,爬虫资源全耗在重复内容上,真正的核心页面反而被稀释。

第 2,AI 引擎面对这类 URL 根本无法判断内容意图,直接跳过。

第 3,多个 URL 指向相似内容,AI 无法确认哪个是"最权威的答案源",即使勉强引用也是随机选择。

解决方法:用 canonical 标签指定权威版本,对筛选参数做 noindex 处理,或者改用 JavaScript 前端渲染筛选状态而不生成新 URL。

动作 3:建立防御重定向体系,主动管理 AI 幻觉 URL

回到开头的案例。AI 幻觉 URL 是真实存在的系统性问题。

Ahrefs 研究了 1600 万个 URL 的数据;Search Engine Journal 的报告显示,AI 搜索导致用户访问 404 页面的频率是 Google 搜索的近 3 倍;SEranking 数据显示 ChatGPT 引用的 URL 中约有 2.38% 返回 404 错误。

这意味着你现在就需要做一件事:打开 GA4 或服务器日志,过滤来源为 ChatGPT 的 404 请求,列出 AI 正在向用户推荐的"幻觉 URL"清单,然后建立 301 重定向指向正确页面。

这不是被动等待,是主动管理你的 AI 时代地址本。

URL 只是起点——页面结构必须同步跟上

很多人优化完 URL 就认为大功告成,其实踩了另一个坑。

「AI 看不到折叠组件里的内容。」

LLM(大语言模型)在爬取内容时,处理的是静态 HTML 文本。CSS 和 JavaScript 控制的折叠展示(accordion)、toggle 组件——这些对用户来说是"点开能看到",但 AI 读到的 HTML 里,内容是隐藏的。

很多独立站的 FAQ 页面用了折叠组件来展示问答,觉得既整洁又好看。但对 AI 来说,那些 Q&A 不存在。AI 判断你的页面"权威性不足",不引用你,然后你就不明白为什么 URL 优化了半天 GEO 效果没变化。

解决方式:核心内容不要放进折叠组件,或者确保关键信息在静态 HTML 中可见。使用语义 HTML 标签——section、nav、h1-h6、alt text——这些是 AI 理解页面内容层次结构的直接信号。

还有一点值得关注:「人类撰写的内容在 AI 搜索环境中反而比 AI 生成内容排名更靠前。」 AI 可以识别 AI 写的内容(基于模式识别),因此品牌的独特视角、真实案例、有个性的写作风格,是 GEO 的竞争护城河。你的品牌内容越有人味儿,AI 越愿意引用。

另外,LLMs.txt 这个概念值得了解一下。它类似 robots.txt,是向 AI 系统说明"哪些内容可以被引用"的指令文件,由 Jeremy Howard 于 2024 年 9 月提出,官网是 llmstxt.org。但要注意:目前 OpenAI、Anthropic、Google 等主要 AI 平台均未正式支持这一标准,它还处于提案阶段,关于其效果的宣传需要谨慎对待。关注就好,还不到全力押注的时机。

URL GEO 自查清单(可立即执行)

给独立站运营者一个可以今天就开始做的清单:

「第 1 条:」 检查现有 URL,slug 是否包含描述性词汇?还是清一色 ID 编号(如 /products/12345)?

「第 2 条:」 核心内容页的 URL 层级是否在 3 层以内?层级过深的页面 AI 爬取频率更低。

「第 3 条:」 有没有参数 URL 爆炸的问题?打开 Search Console 检查索引页面数量,超过实际内容页数量太多就是信号。

「第 4 条:」 打开 GA4,过滤来源中包含 "chatgpt" 或 "openai" 的 404 请求——这就是你的 AI 幻觉 URL 名单。

「第 5 条:」 检查页面是否大量使用折叠组件展示核心信息,有的话把关键内容移出来。

「第 6 条:」 slug 的词汇有没有暗示内容类型?指南类带 guide、对比类带 compare、数据类带 data——这是你向 AI 发出的意图信号。

「第 7 条:」 每个核心页面有没有清楚的 H1 标签、作者信息、更新日期?这些是 AI 判断内容权威性的基本信号。

URL 是品牌在 AI 世界的地址。地址写清楚了,AI 才能把客人送到你家门口。地址写乱了,客人不是找不到门,就是被送去了一个根本不存在的房间。

AI 搜索正在重新定义流量的分配方式。这只是开始。